para que puedas empezar – Desde dentro

Además de todos los modelos de lenguajes de IA comerciales que tenemos a nuestra disposición (ChatGPT, Gemini, Claude, etc.),

Además de todos los modelos de lenguajes de IA comerciales que tenemos a nuestra disposición (ChatGPT, Gemini, Claude, etc.), existe todo un mundo de modelos de lenguajes de código abierto que se pueden utilizar para muchas aplicaciones tanto a nivel personal como empresarial. Llevo bastante tiempo trasteando con LLM a nivel local y la verdad es que tener uno que funcione sin necesidad de conexión a internet puede venirnos realmente bien.

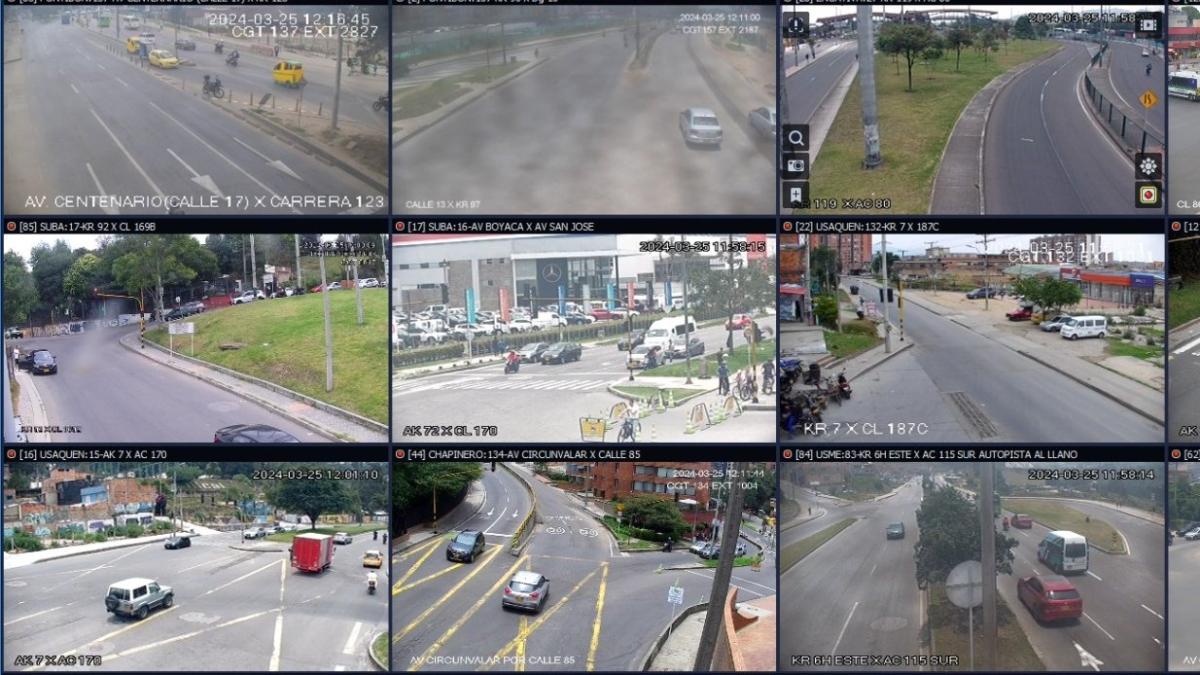

La cuestión es que instalar un LLM localmente y en nuestro móvil es más fácil de lo que parece. Hoy en día encontramos herramientas muy fáciles de utilizar y que cuentan con una interfaz muy amigable para cualquier usuario. Además, no es necesario un smartphone con especificaciones técnicas muy altas para manejar un modelo pequeño. A continuación explico cómo funciona esto y qué sentido tiene tener IA local en el teléfono.

¿Qué es PocketPal y para qué sirve tener una IA en el sitio?

Una de las herramientas que hace esto posible se llama PocketPal AI, y lo mejor es instalarla y ejecutarla. no requiere ningún conocimiento técnico. La aplicación es gratuita para iOS Y Androide y permite la instalación de modelos de inteligencia artificial directamente en el teléfono móvil, permitiendo al usuario utilizarlos sin conexión a Internet, con total privacidad y sin que sus conversaciones lleguen a servidores externos.

La clave para esto es utilizar versiones reducidas de algunos de los modelos de lenguaje que conocemos. Estos pequeños modelos están destinados a ejecutarse directamente en la CPU o GPU de un dispositivo de consumo. No tienen las mismas capacidades de pensamiento que los modelos OpenAI o Anthropic más avanzados, ya que eso sería actualmente imposible en el hardware del teléfono, pero las tienen. Son lo suficientemente potentes para una variedad de tareas cotidianas.: Resumir textos, responder preguntas, traducir, ayudar con la escritura, generar código simple o simplemente tener una conversación.

La sugerencia es útil en más situaciones de las que parece. Imagínese sentado en el metro sin cobertura de red, en un viaje al extranjero sin conexión de datos o en una zona rural. Con una IA instalada localmente en el teléfono Siempre tendrás a mano algún tipo de enciclopedia inteligente: alguien con quien se puede consultar, pensar en voz alta o resolver dudas en el momento. Y lo que es igual de importante: con absoluta privacidad. Todo el procesamiento se realiza íntegramente en el dispositivo. Las conversaciones, indicaciones y datos nunca salen del teléfono ni se almacenan en servidores externos.

¿Qué celular necesitas?

Antes de comenzar a descargar la aplicación, debe verificar si su dispositivo tiene las funciones requeridas. Ejecutar un modelo de IA localmente requiere que el dispositivo cuente con un conjunto de especificaciones técnicas más o menos importantes, aunque no hace falta recurrir a dispositivos de máxima categoría para ejecutarlos. Yo personalmente uso PocketPal en un OnePlus Nord 2 modesto pero más que capaz.

Los modelos de IA son archivos muy grandes, por lo que se requiere algo de espacio de almacenamiento interno libre El procesamiento local requiere rendimiento de hardware. Pero vaya, con que tengas una cantidad importante de RAM y una CPU que no merece la pena, eres más que suficiente.

Los requisitos varían mucho según el modelo que desee instalar. Sin embargo, como pauta general:

- RAM.: Al menos 6 GB para modelos pequeños (parámetros 1-3B). Para modelos medianos con parámetros 7B, se recomienda tener al menos 8 GB.

- Almacenamiento gratuito: Entre 2 y 5 GB para los modelos más ligeros. Un modelo PocketPal AI normalmente requiere entre 1 y 4 GB por instalación.

- procesador: Cualquier rango medio superior de los últimos cuatro o cinco años funcionará. Para modelos más exigentes y con más parámetros se recomienda un procesador muy potente.

- Sistema operativo: Para poder utilizar PocketPal específicamente, se requiere Android 7.0 (Nougat) o superior en Android; A partir de iOS 15.1 también está disponible para iPhone.

La buena noticia es que los modelos más ligeros como Qwen2.5-1.5B, Incluso pueden funcionar en dispositivos más modestos. El propio equipo de PocketPal lo recomienda como punto de partida. La cosa es intentarlo. Por ejemplo, instalé Qwen3-4B y funciona bastante bien en un teléfono de gama media de 5 años.

Cómo instalar PocketPal paso a paso

Para que PocketPal funcione correctamente en tu teléfono móvil, no tienes que hacer mucho. A continuación te explicamos paso a paso cómo hacerlo:

1. Descarga la aplicación

PocketPal AI está disponible tanto en Android Play Store como en Apple App Store. Enlaces para Androide y para iOS.

2. Descarga un modelo de IA

Una vez que esté dentro, la aplicación le pedirá que descargue un modelo para comenzar. Aparece una lista de los modelos disponibles en «Modelos». No encontrará nombres como Gemini o GPT en esta lista, que son modelos propietarios. En su lugar, verá sus versiones de código abierto: Gemma es la versión abierta de Gemini de Google; Lama es el metamodelo, la misma IA que usan WhatsApp e Instagram; Phi es el modelo abierto de Microsoft; y Qwen proviene de Alibaba, entre otros.

Si eres nuevo y quieres probarlo, Qwen2.5-1.5B es quizás uno de los más recomendados y ligeros. Produce buenos resultados para consultas sencillas y es bastante rápido (siempre que el hardware de tu teléfono esté más o menos actualizado). Si tu teléfono tiene más de 6 GB de RAM y mucho espacio libre, puedes probar modelos con parámetros 3B-4B como Llama 3.2 3B, que ofrece respuestas más sofisticadas.

Lo bueno de esto es también Tienes el repositorio completo de Hugging Face Para probar, haga clic en el botón en la esquina inferior derecha. Aquí podemos instalar cualquier modelo directamente desde Hugging Face, como el Qwen3-4B-Instruct que instalé en el Nord 2, o probar otros de DeepSeek o Mistral. Todo funciona a través de la aplicación sin salir de ella.

Importante: Se requiere una conexión a Internet para descargar el modelo. Sólo tienes que estar conectado en el primer momento. A partir de entonces todo funciona localmente.

3. Carga el modelo y comienza a chatear.

Después de la descarga, haga clic en el modelo para cargarlo en la memoria. Luego ve a la sección “Chat”, escribe tu mensaje y la IA lo procesará completamente en tu teléfono. Puedes comprobarlo apagando el WiFi y los datos.

¿Qué rendimiento puedes esperar?

Es aconsejable ser realista. La IA local en dispositivos móviles no es ChatGPT. las respuestas Llegan más lentos y el teléfono se calienta un poco más de lo habitual debido al uso intensivo del procesador. En móviles de gama alta, los modelos generan entre 5 y 20 tokens por segundo, suficiente para mantener una conversación fluida, pero lejos de la velocidad de un servidor con GPU.

Para obtener más rendimiento en el iPhone, existe una opción para habilitar Metal, la API de aceleración de hardware de Apple, y aumentar el parámetro Capas en GPU a alrededor de 80. Con este cambio, iOS cambia parte del procesamiento de la CPU a la GPU del dispositivo, acelerando notablemente la generación de texto. En algunos dispositivos más nuevos, habilitar la opción Flash Attention también puede proporcionar una mejora adicional.

En cuanto al tamaño de archivo que mejor funciona, usarlo en teléfonos inteligentes y tabletas es la solución óptima. Los modelos en formato .gguf tienen un tamaño aproximado de 4 GB. Por encima de esa cifra, las cosas se ralentizan significativamente.

PocketPal no es la única opción

PocketPal es probablemente la app más accesible, pero también tenemos otras alternativas. En Android, MNN Chat también cuenta con soporte multimodal. Para quienes utilizan iPhone también existe Private LLM, aunque es de pago e incluye modelos optimizados que utilizan técnicas de cuantificación para conseguir un mejor rendimiento en dispositivos más modestos.

Si quieres hacer lo mismo pero en una computadora, hay dos referencias: Ollama y Estudio LM. Con ellos es muy fácil tener una IA local en tu PC. LM Studio tiene una interfaz visual muy fácil de usar. Ollama es más técnico pero más flexible. Ambos son gratuitos y le permiten ejecutar modelos con hasta 13B de parámetros o más dependiendo del hardware de su computadora.

Merece la pena, con matices.

Una IA local en dispositivos móviles no reemplaza a los grandes asistentes que conocemosal menos por ahora. Para tareas complejas, documentos largos o consideraciones exigentes, las versiones de servidor siguen siendo superiores. Pero en el uso diario (aclarar una pregunta, resumir un párrafo, buscar ideas, traducir algo rápidamente o simplemente tener una conversación) los modelos pequeños hacen más que servir. Sin embargo, prepárese para las alucinaciones.

En | Dijeron que la IA de vídeo generativa mataría a Hollywood. De momento la lucha está del lado de la tradición.