Chatgpt lleva a algunas personas al borde de la locura. La realidad es menos alarmante y mucho más compleja – Desde dentro

¿Puede una conversación volverse loca? Una corriente Informe del New York Times Una ola de preocupación por los peligros

¿Puede una conversación volverse loca? Una corriente Informe del New York Times Una ola de preocupación por los peligros de la inteligencia artificial y los efectos que puede tener en nuestra cabeza activados. Perturbación de la realidad, delirios e incluso suicidio. El panorama que nos atrae es terrible. ¿Nos enfrentamos a un nuevo pánico tecnológico frente a una amenaza real o simplemente con un nuevo pánico tecnológico?

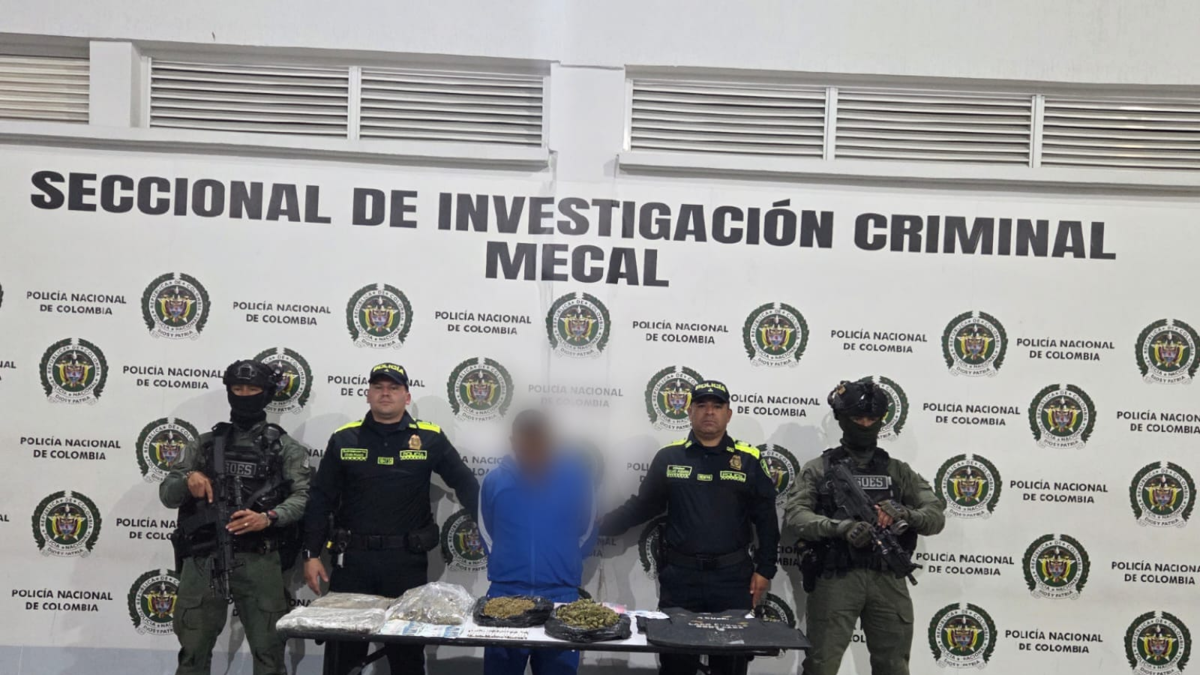

Qué pasó. En un extenso informe que se publicó en el New York Times el fin de semana pasado, se informan varios casos en los que ChatGPT habría promovido teorías de conspiración y ha apoyado ideas peligrosas. Uno de los casos en los que Eugene Torres informa, quien habló con Chatt sobre la teoría de la simulación y fortaleció sus ideas hasta ahora que lo llevó a una condición delirante en la que creía que estaba atrapado en un falso universo en el estilo «matriz» más puro. También mencionan el caso de un hombre con un trastorno bipolar, que fue asesinado por la policía después de una conversación con Chatgpt, ya que tenía que creer que había matado a la IA a quien se había enamorado.

Sin duda son casos alarmantes y este no es el único artículo a este respecto, aunque el que se ha vuelto más viral. Una búsqueda devuelve docenas de resultados que nos informan al respecto Riesgos de usar chatbots en nuestra salud mental. Tienes que buscar mucho para encontrar Posiciones críticas frente a esta ola de alarmismoPorque HayAunque no tienen tanto efecto.

AI como psicólogo. La IA está pendiente en muchos sectores y la salud no es menos. En los Estados Unidos el El uso de chatbots de IA como terapia Y son más y más usuarios Te recurres a Chatt para buscar refugio emocionalalgunos a un Reemplazo del psicólogo. Aunque el uso de IA tiene como apoyo en el proceso terapéutico Aspectos positivos Como inmediatez o el Diagnóstico tempranoEllos también existen Desagradables. El Falta de vínculo humano Y Complacencia excesiva A partir de este tipo de chatbots, no hace una alternativa a un psicólogo y puede ser particularmente peligroso para las personas que sufren un tipo de trastorno.

El tamaño del problema. No tenemos datos de personas que usen Chatt con una intención terapéutica o validen las teorías de conspiración, sino como con cualquier tecnología masiva (en febrero de este año fue 400 millones de usuarios mensuales) Obviamente habrá innumerables casos de todo tipo. No podemos confirmar que es la IA quien causa directamente estas delirios o alucinaciones. De hecho, las situaciones viralizadas tienen muchos matices y son más complejos que un «El error es AI». ChatGPT juega un papel, pero la foto es más grande.

El mismo miedo a siempre. El temor de que las máquinas dominen el mundo y pongan fin a la humanidad En cultura popularPero con la llegada de IA esta amenaza Comienza a sonar más factible (Aunque hay expertos que Crees que es ridículo).

Es el mismo miedo que ha surgido con una nueva tecnología y no lo ha sido recientemente. Ya en las historias del siglo XIX de Telegraphs transmitidos en Morse desde el Más Allá. Si hacemos ejemplos más nuevos, tenemos uno muy claro: los videojuegos. Tener Matanza en las escuelas Y incluso tienen En comparación con la heroína. Y con los teléfonos celulares se ha dicho durante años que Ellos causan cáncer. En resumen, los pánicos sociales que hemos vivido muchas veces.

El riesgo de un complaciente. Aunque hay mucho alarmismo, no podemos descartar que hay un problema. Como dije, la complacencia excesiva de los chatbots a menudo lo hace Nos dan razón al final En nuestras ideas y esto puede ser peligroso en ciertos casos, especialmente si una patología está detrás.

La verdad es que algunas sugerencias que Chatt dio a las personas que aparecen en el informe fueron mucho más allá de la simple indicación. Por ejemplo, Torres sugirió que dejara de tomar su miedo y tomó a Ketamine como un «liberador temporal del patrón». Hay quienes creen que este tipo de noticias son deliberadamente. Este es el caso de Eliezer Yudkowsky, un defensor de escritor estadounidense El amistoso Esto publicó un hilo extenso En x Donde sugirió que la IA «sabe» lo que estaba haciendo: «Lo que sea que Chatt contenga, sabía lo suficiente sobre las personas para saber que empeoró la locura de una persona».

Que hace OpenAi. De acuerdo con esta excesiva complacencia en abril pasado Operai retiró una actualización Porque su IA era demasiado agradable y halagadora y que algunos usuarios se asustaron. Desde NYT, contactó a OpenAI sobre las declaraciones de estos usuarios y OpenAI respondió con una explicación:

Observamos más signos de que las personas crean conexiones o enlaces a Chatt. Dado que IA está integrado en la vida cotidiana, tenemos que abordar cuidadosamente estas interacciones. Sabemos que ChatGPT puede ser más receptivo y personal que las tecnologías anteriores, especialmente para las personas que necesitan protección, lo que significa que está en juego más. Estamos trabajando en la comprensión y la reducción de la forma en que ChatGPT podría fortalecer el comportamiento negativo existente o intensificar involuntariamente.

Imagen de portada | PexelsModificado con chatgpt

En | La amabilidad con ChatGPT proviene de OpenAai: la «solicitud» y «gracias» tienen costos absurdos cada uno